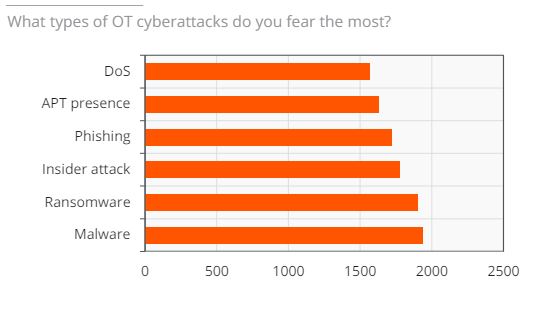

Cyberkriminelle nutzen KI, um die Häufigkeit und Durchschlagskraft ihrer Angriffe zu erhöhen. Und es gibt inzwischen immer mehr Neulinge, die sich als Cyberkriminelle versuchen. Sie verwenden KI-Tools von der Stange, um Schadsoftware zu erstellen und einsetzen. Somit kann jeder, der böse Absichten hegt, innerhalb kürzester Zeit eine Malware entwickeln, in Umlauf bringen und in Unternehmen jeder Größe verheerende Schäden anrichten. Mit den leicht erhältlichen KI-Tools können selbst unerfahrene Akteure Denial-of-Service-Angriffe durchführen, Phishing-E-Mails erstellen oder Ransomware einsetzen. Diese Angriffe können dann gleichzeitig von zahlreichen Systemen auf der ganzen Welt ausgeführt werden, sodass es für die verantwortlichen Mitarbeiter nahezu unmöglich ist, alle angegriffenen Systeme rechtzeitig zu identifizieren.

Mit KI gegen Hacker vorgehen

KI und Deep-Learning-Technologien bieten auch ein wirksames Mittel im Kampf gegen Cyberkriminalität. KI-gesteuerte Sicherheitslösungen mit selbstlernenden Funktionen können proaktiv auf neu auftretende Bedrohungen reagieren und Unternehmen auf diese Art und Weise vor der Vielzahl von Angriffen schützen, so dass sie wieder Macht über ihre Daten haben. Mit KI-gestützten Sicherheitstools lassen sich beispielsweise Anomalien und Muster erkennen, die auf bösartiges Verhalten hinweisen, und Angriffe stoppen, bevor diese Schaden anrichten. Dieser intelligente Datenschutzansatz verringert die Abhängigkeit von reaktiven Maßnahmen und versetzt Unternehmen in die Lage, Cyberkriminellen einen Schritt voraus zu sein. KI- und Deep-Learning-Schutzsysteme sind zudem in der Lage, sich anzupassen und weiterzuentwickeln, um neuen Bedrohungen zu begegnen. Sie lernen aus vorausgegangenen Vorfällen und verbessern so kontinuierlich ihre Abwehrmechanismen. Durch Techniken wie Transfer Learning können diese Systeme ihre Wissensbasis ständig mit den neuesten Erkenntnissen über Bedrohungen anreichern und eine zunehmend größere Widerstandsfähigkeit gegen Angriffe entwickeln. Diese Systeme leiten auf der Grundlage vordefinierter Regeln oder erlernter Verhaltensweisen auch proaktiv automatische Maßnahmen ein. Wenn ein System beispielsweise eine Sicherheitsverletzung oder eine Anomalie ausfindig macht, kann es automatisch Maßnahmen wie die Isolierung der betroffenen Systeme oder die Blockierung verdächtigen Datenverkehrs einleiten. Diese automatische Reaktion verkürzt die Zeit zwischen der Erkennung und Behebung eines Cyberangriffs und minimiert so die potenziellen Auswirkungen.

Bei der Implementierung von KI- und Deep-Learning-Tools ist es wichtig, die damit verbundenen Herausforderungen zu berücksichtigen. So können immer wieder Fehler auftreten, denn KI befindet sich noch in der Entwicklung und ist nicht zu 100 Prozent sicher. Manchmal kann es also zu Fehlinterpretationen kommen, die die Verfügbarkeit von Daten oder Systemen beeinträchtigen. Solche Störungen kommen vor allem dann vor, wenn die KI etwas entdeckt, was sie für eine illegale Aktivität hält. KI-Tools arbeiten z.B. oft mit einer Zuverlässigkeitsbewertung. Ein Unternehmen kann also festlegen, dass vorbeugende Maßnahmen ergriffen werden, wenn der Wert unter einen bestimmten Schwellenwert fällt. Aber Achtung: Eine solche Präventionsmaßnahme kann nicht nur unnötig sein, sondern auch zu ungeplanten Ausfallzeiten führen. Da sich die KI-Technologie ständig weiterentwickelt, kann sie keine absolute Perfektion garantieren. Deshalb wird die Gefahr von Fehlern jetzt und in Zukunft immer bestehen. Doch je mehr Menschen die Technologie nutzen und mit verschiedenen Bedrohungen konfrontiert werden, desto zuverlässiger werden die KI-Systeme in der Lage sein, echte Bedrohungen von vermeintlich bedrohlichen Situationen zu unterscheiden.